İçindekiler

- Sunucu Logları Analizi: Yapay Zeka Destekli Adım Adım Rehber

- Sunucu Kurulumu ve Log Toplama: Neyi, Nasıl Kaydetmeliyiz?

- Kök Neden Analizi İçin Yapay Zeka Modelleri ve Yöntemleri

- Güvenlik İçin Log Analizinde Yapay Zeka

- Performans Artışı İçin Kök Neden Analizi Uygulamaları

- İşletim Sistemleri ve Log Yönetimi

- Pratik Örnekler ve Adım Adım Uygulama Planı

- En İyi Uygulama Tavsiyeleri ve Sık Yapılan Hatalar

- Sonuç ve Gelecek Perspektifi

Günümüzde sunucuların ürettiği günlükler adeta birer dijital göstergedir. Kök neden analizi için bu günlükleri tek başına okumak yetersiz kalır; yapay zeka destekli yaklaşımlar, bu veriyi anlamlı işlere dönüştürerek güvenlik tehditlerini, performans dengesizliklerini ve konfigürasyon hatalarını daha hızlı tespit etmenize olanak tanır. Bu rehberde, sunucu logları analizi alanında yapay zekayı adım adım nasıl kullanabileceğinizi pratik örneklerle ele alıyoruz. Sonuç olarak kök nedeni bulmak için sistematik bir yol haritası ve eylem planı sunuyoruz. Peki ya kis aylarinda veya yoğun trafik dönemlerinde bu süreç nasıl çalışır? Cogu durumda AI, tekrarlayan desenleri tanır ve insan uzmanının dikkatini kritik noktaya yönlendirir.

Sunucu Logları Analizi: Yapay Zeka Destekli Adım Adım Rehber

Sunucu logları analizi, bir dizi farklı log kaynağından gelen veriyi anlamlı bilgiler haline getirme sürecidir. Yapay zeka ise bu süreci hızlandırır, hatalı işaretleri azaltır ve trendleri öngörülebilir hale getirir. Bu rehber, temel kavramlardan başlayarak, gerçek dünyadaki senaryolara kadar uzanan bir yol haritası sunar. Özellikle güvenlik ve performans odaklı kullanımlarda yapay zekanın gücü, karmaşık olay dizilerini bağlam içinde görmenize olanak tanır. Üstelik modern log yönetim çözümleriyle entegrasyonlar kurmak da artık daha erişilebilir hale geldi. Sonuç olarak, kök nedene giden yol çoğu zaman log verisini temizlemekten, anlamlı modeller oluşturmaya ve operasyonel aksiyonlar almaya uzanır.

Kök neden analizinin temel adımları

- Veri toplama: Log kaynakları (syslog, güvenlik olayları, uygulama logları) merkezi bir noktada toplanır.

- Ön işleme: Zaman damgaları eşleşir, anomaliler ayıklanır, olaylar normalize edilir.

- Öznitelik mühendisliği: Sık tekrar eden desenler, gecikmeler, hata kodları gibi metrikler çıkarılır.

- Modelleme: Anomali tespiti veya zaman serisi analizi ile kök nedeni tahminleri üretilir.

- İzleme ve tepki: Uyarılar tetiklenir, aksiyonlar otomatik veya yarı otomatik olarak uygulanır.

Sunucu Kurulumu ve Log Toplama: Neyi, Nasıl Kaydetmeliyiz?

İlk adım, hangi logların kök neden analizinde değerli olduğunu belirlemektir. Cogu sistemde kritik loglar şu başlıklar altında toplanır: sistem olay günlükleri (Linux için journald veya rsyslog), güvenlik olayları (auditd, Windows Event Logs), uygulama günlükleri ve ağ aygıtlarının logları. Logları merkezi bir log yönetim çözümüne taşıyarak zaman damgalarını standartlaştırmak, analiz için temel bir adımdır. Ayrıca log döndürme (log rotation) ve saklama politikaları da belirlenmelidir; aksi halde kısa sürede veriler hızla silinebilir veya bozulabilir.

Anahtar uygulamalar:

- Linux tabanlı sunucular için rsyslog veya journald ile logları merkezi bir yere yönlendirme.

- Windows tarafında Windows Event Forwarding (WEF) veya native merkezi loglama çözümleri.

- Uygulama loglarına özel bir schema kullanma (ör. JSON logları, alan adları sabitleme).

- İşletim sistemi bağımsız bir SIEM veya merkezi log yöneticisi ile logları indeksleme.

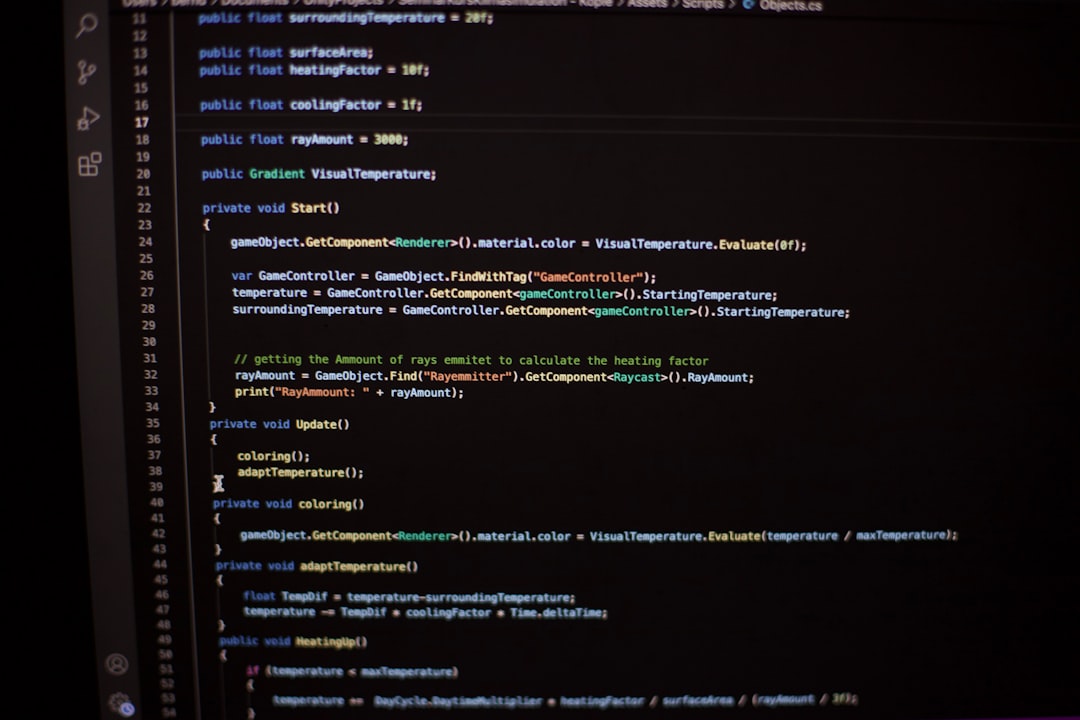

Kök Neden Analizi İçin Yapay Zeka Modelleri ve Yöntemleri

Yapay zeka, kök nedeni bulma sürecinde üç temel yaklaşımı destekler: anomali tespiti, dizisel analiz ve bağlamsal ilişki çıkarımı. Basit ama etkili bir başlangıç için şu modeller sıklıkla kullanılır:

- Olağanüstü durumları tespit eden denetimli olmayan modeller (Anomaly Detection) – günlüklerdeki beklenmedik kalıpları yakalar.

- Zaman serisi modelleri (ARIMA, LSTM, Prophet) – belirli olayların ardışık etkilerini öngörür ve anormal hareketleri çerçevelendirir.

- Graf tabanlı yaklaşımlar – olaylar arasındaki ilişkiyi görselleştirir, hangisinin tetikleyici olduğuna dair ipuçları verir.

- Otoenkoderler ve temsil öğrenimi – yüksek boyutlu log verisini daha anlamlı bir formatta sıkıştırır.

İpuçları: Verinin kalitesi, model başarısında kritik rol oynar; hatalı etiketler ve eksik veriler model güvenilirliğini düşürebilir. Bu nedenle veriyi temiz tutmak, etiketleri netleştirmek ve sürekli model güncellemelerini planlamak gerekir.

Güvenlik İçin Log Analizinde Yapay Zeka

Güvenlik açısından yapay zeka, kötü niyetli davranışları önceki güvenlik olaylarıyla ilişkilendirerek gerçek zamanlı tehditleri işaret eder. Tek başına bir log kaydı itibariyle karar vermek riskli olabilir; bu nedenle bağlamsal analizler devreye girer. Örneğin, tekrarlayan başarısız oturum açma girişimleri, belirli IP aralıklarından gelen yoğun istekler ve anormal saat dilimlerinde gerçekleşen olaylar bir araya geldiğinde potansiyel brute-force saldırılarına işaret edebilir. Uzmanlarin belirttigine göre, yapay zeka destekli güvenlik analizi, bu tür olayları tek tek loga bakmadan hızlıca tespit eder ve müdahale süresini önemli ölçüde kısaltır.

Güvenlik odaklı pratikler:

- Olaylar için çoklu kanıt (multi-signal) yaklaşımı kullanma – loglar, ağ trafiği ve kimlik doğrulama verileriyle çapraz doğrulanır.

- Gerçek zamanlı uyarılar kurma – belirli eşikler aşıldığında otomatik bildirim gönderme.

- Olay sonrası inceleme için olay geçmişi ve bağlam saklama – hangi adımların tehditleri tetiklediğini anlamaya yarar.

Performans Artışı İçin Kök Neden Analizi Uygulamaları

Kök neden analizi, performans sorunlarını hızlı tespit edip kaynaklarını izole eder. Örneğin yüksek CPU kullanımı, bellek sızıntıları, I/O bekleme süreleri veya veritabanı kilitlenmeleri gibi durumlar loglar üzerinden izlenebilir. Yapay zeka bu verileri bağlam içinde değerlendirir; ani artışlar ile günlük kalıplar arasındaki farkı ayırt eder ve hangi olay zincirinin performans düşüşüne yol açtığını gösterir. Sonuç olarak, kapasite planlaması ve konfigürasyon iyileştirmeleri için somut öneriler sunulur. Üstelik bu yaklaşım, tekrarlayan sorunları otomatikleştirilmiş bir şekilde belirleyerek operasyonel verimliliği artırır.

- Gecikme kaynaklarını belirlemek için uygulama logları ile altyapı loglarını birleştirme.

- Kaynak sınırlarını tespit etmek için zaman damgalı metrikler üretme.

- Otomatik uyarılar ve düzeltici eylemler için AI tabanlı öneri motorları kurma.

İşletim Sistemleri ve Log Yönetimi: En Uygun Yaklaşımlar

İşletim sistemlerine göre log yönetimi farklılık gösterebilir. Linux dünyasında journald, rsyslog veya fle- sistemleriyle loglar merkezi bir yere yönlendirilirken Windows tarafında Event Forwarding ve güvenli log depolama kritik rol oynar. En yaygın uygulama, logların JSON formatında standartlaştırılması ve merkezi bir SIEM veya log analizi motoruna aktarılmasıdır. Ayrıca log saklama süreleri, gizlilik ve uyumluluk gereksinimleri göz önünde bulundurularak belirlenmelidir. Lojistik olarak, logların zaman damgalarının UTC veya yerel saate göre tutarlılığı sağlanmalıdır; aksi halde olaylar arasındaki bağlam bozulabilir.

İşletim sistemi odaklı ipuçları:

- Linux için rsyslog+rsync veya merkezi log sunucusu kullanımı.

- Windows için WEF ile güvenli log aktarma ve güvenlik politikaları.

- Log saklama politikaları ve veri koruma uyumu (ör. KVKK/GDPR) gereklilikleri.

Pratik Örnekler ve Adım Adım Uygulama Planı

Aşağıda, gerçek dünya senaryolarında uygulanabilir bir adım adım plan sunuyoruz. Bu plan, hemen uygulanabilir küçük adımlardan oluşur ve zaman içinde genişletilebilir.

- Planlama: Hangi logların inceleneceğini ve hangi metriklerin izleneceğini belirleyin.

- Veri hazırlama: Log formatlarını normalize edin, zaman damgalarını tutarlı hale getirin.

- Model seçimi: Basit bir anomali tespit modeli ile başlayın; gerektiğinde zaman serisi analizine geçin.

- İzleme: Gerçek zamanlı görselleştirme ve uyarı mekanizmalarını devreye alın.

- İyileştirme: Gözlemlerden elde edilen geri bildirimlerle model ve kuralları güncelleyin.

En İyi Uygulama Tavsiyeleri ve Sık Yapılan Hatalar

Bu alanda güvenilir sonuçlar elde etmek için bazı temel tavsiyeleri akılda tutmak yeterli olacaktır. Ayrıca sık yapılan hatalardan kaçınmak da kritik. İşte öne çıkan noktalar:

- Veri kalitesi her şeydir: Eksik veya hatalı etiketli veriler modelin güvenilirliğini düşürür.

- Bağlamı saklayın: Olaylar arasındaki ilişkiyi anlamak için bağlamsal verileri bir arada tutun.

- Geri bildirim döngüsünü kurun: Uzmanlar tarafından onaylanan kararlar, modellerin performansını iyileştirmek için kullanılsın.

- Gereksiz alarm azlığına dikkat edin: Çok sık uyarı, olayları gözden kaçırmanıza yol açabilir; dengeli eşikler kurun.

Sonuç ve Gelecek Perspektifi

Sunucu logları analizi, yapay zekanın desteğiyle güvenlik ve performans konularında proaktif bir yaklaşım sağlar. Dataların merkezi ve temiz bir şekilde yönetilmesi, kök neden analizi süreçlerini hızlandırır ve operasyonel verimliliği artırır. Su an icin en iyi yöntem, mevcut altyapıyı korumak ve evrensel bir günlük stratejisi oluşturmaktır. Göz ardı edilmeyen gerçek ise, teknolojinin ilerlemesiyle birlikte yapay zekanın log analizi süreçlerinde daha akıllı kararlar almak için daha çok yetenek kazanacağıdır. Siz de bu yaklaşımı kendi sunucularınıza uygulamaya başlayın ve elde ettiğiniz sonuçları bizimle paylaşın.

Sıkça Sorulan Sorular (FAQ)

sunucu logları analizi ile yapay zeka hangi alanlarda en etkili sonuçları verir?

Genelde güvenlik olaylarının erken tespiti, performans darboğazlarının belirlenmesi ve operasyonel hataların kök nedenlerini bulma alanlarında etkilidir. AI, büyük hacimli verideki desenleri fark eder ve manuel incelemeyi azaltır.

Kök neden analizi için hangi veriler gereklidir ve nasıl bir entegrasyon kurulmalıdır?

Gerekli veriler: sistem logları, güvenlik olayları, uygulama logları, ağ cihazı logları ve zaman damgaları. Entegrasyon için merkezi bir log yönetim sistemi ve güvenli bir veri akışı (ör. SIEM) kurulur; veriler temizlendikçe modellemeye alınır.

İşletim sistemi loglarıyla yapay zeka kullanımı için başlangıç adımları nelerdir?

Başlangıç adımları: logları standart bir formata çevirin, temel anomali kuralları ve basit zaman serisi modelleriyle başlayın; ardından bağlamsal verileri ekleyerek model kapasitesini genişletin.

Not: Unutmayın, yapay zeka destekli kök neden analizi bir yolculuktur. İlk adımı atın, verinizi temizleyin ve zamanla daha sofistike modellerle ilerleyin. Bu süreçte sabırlı olmak ve sürekli iyileştirme döngüsünü sürdürmek başarıyı getirir.

Çıkış noktası: Kök neden analizi için yapay zekayı kademeli olarak entegre etmek, güvenlik, performans ve güvenilirlik hedeflerinize ulaşmanıza yardımcı olur. Şimdi adımlara başlayın ve sonuçları bana bildirin.

Eğer siz de kendi sunucu ortamınızda yapay zeka destekli kök neden analizi kurmaya hazırsanız, bu rehberi uygulamaya koyun. Deneyimlerinizi ve sorularınızı yorumlarda paylaşın; birlikte daha sağlam bir log analizi güvenliği oluşturabiliriz.