Günümüz veri merkezi ortamlarında sunucu logları, güvenlik ihlallerinden performans darboğazlarına kadar bir çok kritik sinyali barındırır. Yapay zeka destekli özelleştirilmiş anomali tespiti ile bu loglardan elde edilen bilgiler anlamlandırılır, olaylar otomatik olarak sınıflandırılır ve tepkiler zamanında uygulanır. Bu yazıda, özellik mühendisliği süreçlerinden ölçeklenebilir uygulama mimarisine kadar ayrıntılı bir yol haritası sunulacak; ayrıca gerçek dünya kullanımlarına dair pratik ipuçları paylaşılacaktır. Özellikle sunucu kurulumu, sunucu güvenliği, sunucu temizliği, sunucu logları ve işletim sistemleri bağlamında nasıl ilerlemeniz gerektiğini adım adım açıklıyoruz. Peki ya kis ayları, bakım kesintileri ya da çoklu lokasyonlar söz konusu olduğunda hangi kriterler devreye girer? Kesinlikle, yapay zeka destekli çözümler bu sorulara yanıt bulmayı kolaylaştırır ve uzun vadeli operasyonel kazanımlar sağlar.

- Sunucu Loglarında Anomali Tespiti: Temel Kavramlar

- Özellik Mühendisliği ile Anomali Tespiti: Yaklaşımlar

- Ölçeklenebilir Mimari ve Uygulama

- Güvenlik, Bakım ve Performans İçin En İyi Uygulama Prensipleri

- Gerçek Dünya Uygulama Örnekleri

- Sonuç ve Yol Haritası

Sunucu Loglarında Yapay Zeka Destekli Özelleştirilmiş Anomali Tespiti: Temel Kavramlar

Birçok işletme için en değerli varlık, loglar aracılığıyla elde edilen operasyonel içgörülerdir. Sunucu logları, kullanıcı ipuçları, hatalar, erişim denemeleri ve performans göstergeleri gibi bilgileri içerir. Yapay zeka destekli anomali tespiti ise bu verileri yalnızca toplamakla kalmaz; aynı zamanda bağlamlı ilişkileri öğrenir, normal davranış profillerini kurar ve beklenmeyen kalıpları otomatik olarak işaretler. Böylece hatalı alarm (false positive) oranı azaltılır ve güvenlik olayları erken aşamada tespit edilir.

Bu yaklaşımın temel amacı, “normal” davranışın bir profili üzerinden sapmaları ölçmektir. Normalleşme süreci, veri kaynaklarının temizlenmesi, zaman damgalarının senkronize edilmesi ve log formatlarının standardize edilmesiyle başlar. Ardından, loglar üzerinde özellik mühendisliği uygulanır; bu aşama, modelin gerçek dünya verisini doğru yorumlayabilmesi için kritiktir. Bilhassa sunucu kurulumu ve işletim sistemleri bağlamında, farklı sürümlerdeki log biçimleri ve çeşitlenen olay tipleri, altyapı ekibini zora sokabilir. Bu nedenle, özelleştirilmiş bir anomali tespiti yaklaşımı, log kaynaklarınıza özgü özellikler üretmenizi gerektirir.

Uzmanların belirttigine göre, güvenlik odaklı senaryolarda anomali tespiti sadece kötü niyetli davranışları yakalamakla kalmaz; aynı zamanda hatalı yapılandırmalar, düzensiz güncellemeler ve güvenlik açıklarını da ortaya çıkarır. Yalnızca güvenlik amacıyla kullanıldığında bile, log analiz kapasitesi ile olay müdahale süreleri belirgin biçimde iyileşir. İşletim sistemi çeşitliliği, sürüm farkları ve bulut ile on-prem arasındaki entegrasyonlar da bu yaklaşımı daha karmaşık hale getirir; fakat doğru mimari ile bu zorluklar aşılabilir.

Görünen o ki, özelleştirilmiş anomali tespiti, bir yandan mevcut güvenlik politikalarını güçlendirirken diğer yandan performans izleme ve bakım süreçlerini de destekler. Cogu sürücü gibi siz de bu süreci kendi kurulum ve güvenlik hedefleriniz doğrultusunda uyarlayabilirsiniz. Başarı için anahtar nokta, hangi log türlerini, hangi periyotlarda ve hangi bağlamlarda analiz edeceğinizi netleştirmektir.

Özellik Mühendisliği ile Anomali Tespiti: Yaklaşımlar (Sunucu Logları İçin Pratik Özellikler)

Özellik mühendisliği, bir modelin başarısını doğrudan etkileyen kritik bir adımdır. Aşağıda, sunucu logları için uygulanabilir ve uygulanabilirliği yüksek olan bazı özellik kümelerini bulabilirsiniz. Bu özellikler, log tipi, olay yoğunluğu ve bağlamsal bilgiler gibi etkenleri kapsar.

- Zaman tabanlı özellikler: dakikalar aralığında olay sayısı, 5, 15 ve 60 dakikalık pencereler için hareketli ortalamalar, mevsimsel etkileri yakalamak için gün içi ve hafta içi profilleri.

- Agregat metrikler: saatlik hata oranı, istekte bulunan benzersiz IP sayısı, oturum açma başarısızlıkları ve bunların coğrafi dağılımı.

- Bağlam özellikleri: uygulama modülü, sürüm, log seviyesi (INFO, WARN, ERROR), kullanıcı ajanı kategorisi.

- Ağ ve güvenlik bağlamı: kaynak/hedef IP çiftleri, açık duran portlar ve başarısız bağlantı denemelerinin zaman dizileri.

- İş akışı özellikleri: belirli bir iş akışında (ör. yedekleme, güncelleme) meydana gelen olaylar arasındaki gecikmeler ve tekrar denemeler.

- Olay korelasyonu: birbirini tetikleyen olaylar arasındaki gecikmeler, örneğin kimlik doğrulama hatası ile kaynak erişim hatası arasındaki süre farkı.

Özellik mühendisliği sürecinde, önce ham veriden anlamsal olarak değer taşıyan sütunları belirlemek gerekir. Ardından, 2-3 adet pencereli (5, 15, 60 dk) zaman serisi özellikleri üretmek sık kullanılan bir stratejidir. Dikkat edilmesi gereken nokta, çeşitlenen log biçimleri ve ölçeklenebilirlik gereksinimleridir; bu nedenle birden çok sunucu kümesinde testler yapmak elzemdir. Ayrıca, etiketsiz verilerle çalışırken yarı denetimli yaklaşımlar veya anomali skorları üzerinden ince ayar yapmak gerekir.

Yine de, gerçek dünya uygulamalarında şu adımlar çoğu durumda etkili sonuç verir:

– Log kaynaklarını standart bir formata dönüştürün ve sıkı bir tarih/saat senkronizasyonu sağlayın.

– Özellik setini her log türü için ayrı ayrı tasarlayın; örneğin güvenlik logları için hata türü ve kullanıcı davranışı, performans logları için işlem süresi ve throughput değerleri farklıdır.

– Zaman pencerelerini 5, 15 ve 60 dakika gibi değişkenlerle deneyin; bazı senaryolarda kısa pencereler çabuk uyarı verir, uzun pencereler ise daha stabil trendler oluşturur.

– Model güncellemelerini otomatikleştirin; yeni log biçimleri veya yeni sürümlerde performansı düşen modelleri hızlıca yeniden eğitin.

Ölçeklenebilir Mimari ve Uygulama: Sunucu Loglarına Göre Esnek Çözüm Mimarisi

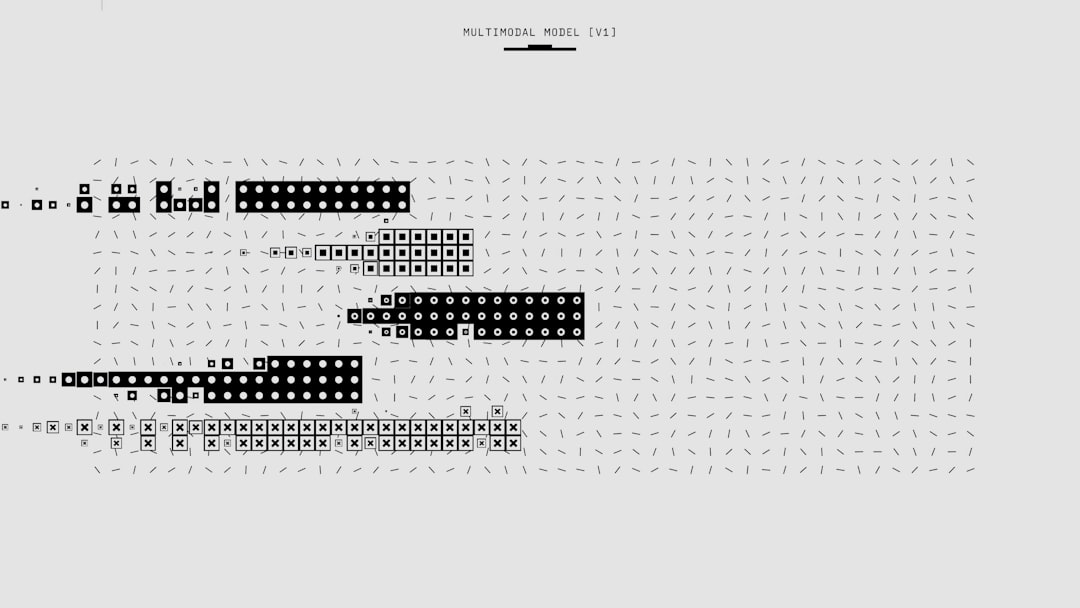

Bir kurumun sunucu loglarını güvenilir ve ölçeklenebilir biçimde yönetebilmesi için uygun bir mimariye ihtiyaç vardır. Aşağıda, modern bir uygulama için önerilen temel bileşenler yer alıyor. Bu mimari, sunucu kurulumu ve yönetimini kolaylaştırır, ayrıca sunucu logları ile yapay zeka tabanlı modellere güvenilir akış sağlar.

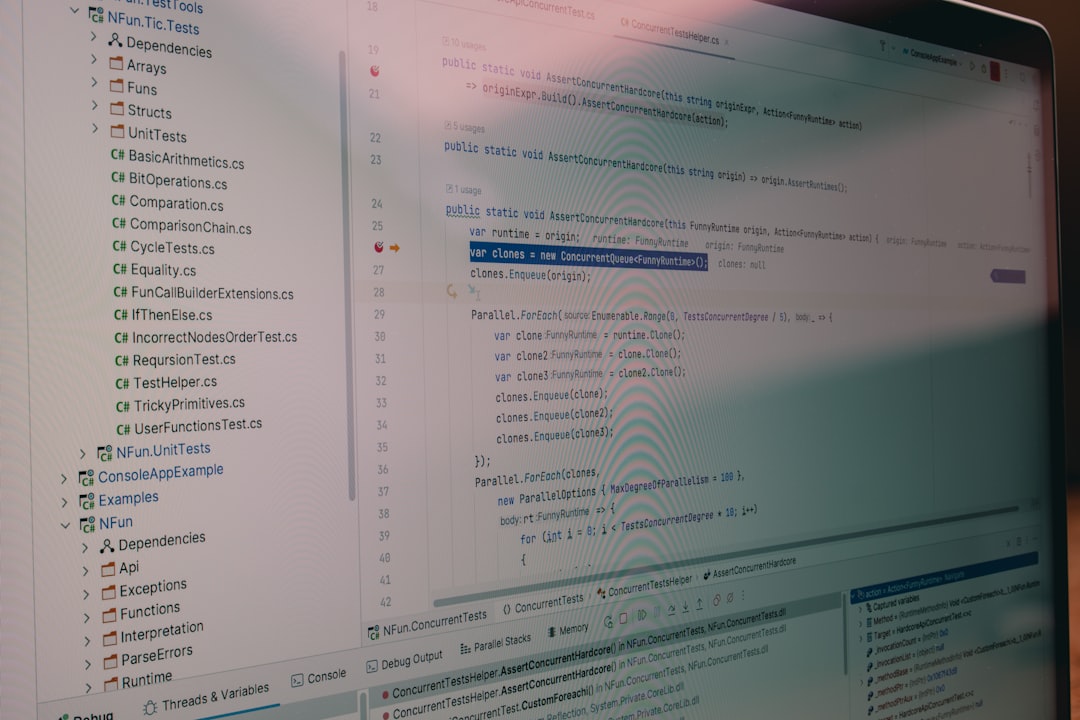

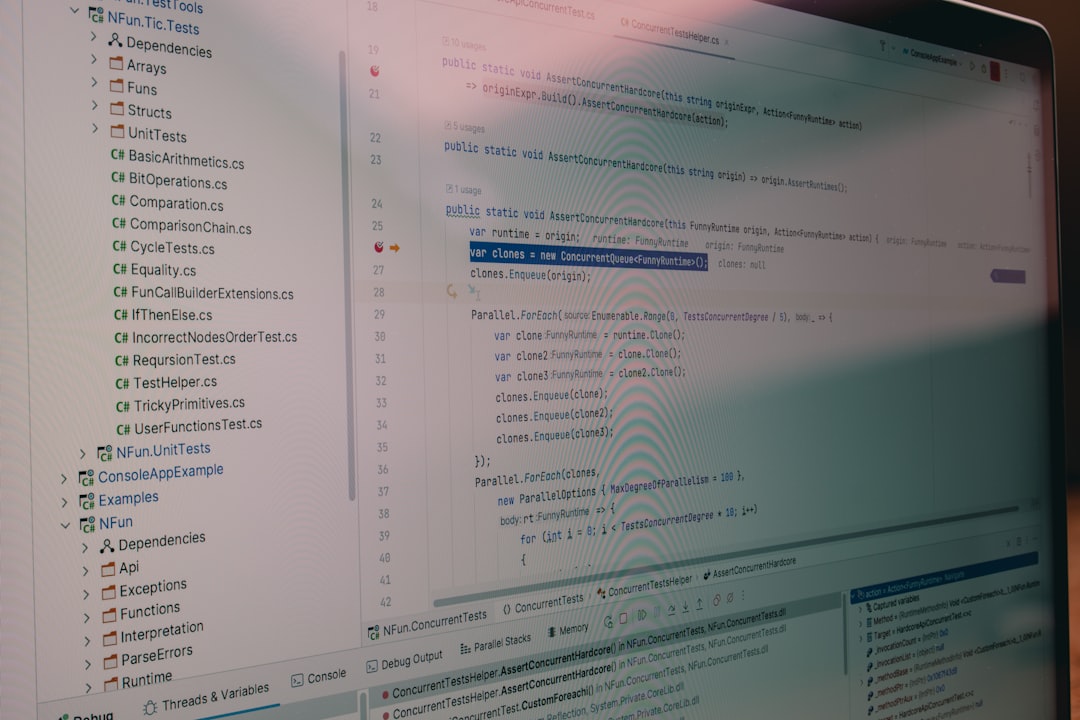

- Veri toplama ve iletimi: Kafka veya benzeri bir mesaj kuyruğu ile log verileri toplanır ve mikroservisler arasında hızlıca iletilir. Örneğin, bir orta ölçekli kuruluş için günlük log hacmi 10 milyon ile 50 milyon arası satır arasında değişebilir.

- Veri işleme katmanı: Flink veya Spark Structured Streaming ile gerçek zamanlı veya near-real-time işleme yapılır. Bu katman, zaman serisi özelliklerinin hesaplanması ve anomali skorlarının üretilmesi işlemlerini yürütür.

- Model eğitimi ve sürümü: Belirli aralıklarla yeniden eğitim yapan bir ML platformu; MLFlow veya Kubeflow benzeri çözümler ile modellerin sürümleri yönetilir.

- Dağıtık inference: mikroservis tabanlı bir deploy ile modellerın skor üretimi, konteynerleştirilmiş ortamlarda (Docker/Kubernetes) çalışır. Böylece ölçeklenebilirlik ve hata toleransı artırılır.

- Depolama ve arşiv: log verileri ve skorlar için hızlı erişim sağlayan zaman serisi veri deposu (ör. InfluxDB, OpenTSDB) ile uzun vadeli arşivleme gerçekleştirilir.

Bu yapı, sunucu güvenliği, sunucu performansı ve işletim sistemleri konularında kritik kararlar almak için gerekli veriyi hızlıca sunar. Ayrıca, sunucu temizliği ve log temizliği süreçlerinde de kolaylık sağlar çünkü loglar önceden temiz ve normalize edilmiştir. Modern ölçeklenebilirlik için mikro hizmet mimarisi ve konteyner tabanlı dağıtım, görüntülendir. Akışkan bir mimari, farklı lokasyonlarda bulunan sunucuların loglarını birleştirebilmenizi sağlar; bu da dünya çapında operasyon yapan kurumlar için büyük avantajdır.

Güvenlik, Bakım ve Performans İçin En İyi Uygulama Prensipleri

Sunucu güvenliği ve performansını artırmak için izlenecek temel prensipler şu şekilde özetlenebilir. Bunlar, sunucu kurulumu sırasında alınması gereken kararları da kapsar. İlk olarak, sunucu logları üzerinde sapmaları hızlıca tespit etmek adına güvenlik odaklı bir anomali tespiti işlevselliği kurulmalıdır. Ancak bu özellik, temiz veri ve güvenli bir ayrışma ile desteklenmelidir. İkincisi, yalancı olumlu (false positive) oranını düşürmek için model izleme mekanizmaları konmalıdır. Üçüncü olarak, bakım süreçlerini kolaylaştırmak adına otomatik tetiklenen uyarılar ve önerilen eylem setleri (ör. yeniden başlatma, yapılandırma değişikliği) kullanılmalıdır.

– Güvenlik odaklı konfigürasyonlar: log seviyesi ve önemli olay türleri için filtreler belirleyin; arka planda anomali skorları yüksek olan olaylar için hızlı yanıt mekanizması kurun.

– Bakım ve temizlik: log arşivleme politikaları ile depolama maliyetlerini optimize edin; eski loglar için sıkıştırma ve periyodik temizleme süreçlerini otomatikleştirin.

– Performans odaklı izleme: işlemci ve bellek kullanımındaki sapmalar, IO gecikmeleri, ağ gecikmeleri gibi metrikleri zaman içinde takip edin ve anomali skorları ile ilişkilendirin.

– Geri bildirim mekanizması: güvenlik olaylarıyla sonuçlanan müdahalelerin sonucunu model geri bildirimine aktarın; böylece güvenlik odaklı modeller zamanla daha güvenilir hale gelir.

İstisnalar her zaman olabilir; bazı loglar çok yüksek yoğunluklu veya çok kısa ömürlü olaylar içerir, bu durumda anomali tespiti performansı etkileyebilir. Kesin olmamakla birlikte, şu anki en iyi uygulama, çok katmanlı bir yaklaşım kullanmaktır: güvenlik odaklı modellerla birlikte performans ve bakım loglarını da kapsayan çok amaçlı modeller. Böylece hem güvenlik hem de operasyonel verimlilik yükselir.

Gerçek Dünya Uygulama Örnekleri

Bir kurumsal birim, logları üzerinde yapay zeka tabanlı anomali tespiti ile şu gibi değerli içgörüler elde edebilir:

- Güvenlik olaylarının erken tespiti: kötü niyetli giriş denemelerinin zaman içinde artış eğilimlerini yakalamak ve çok faktörlü doğrulama gerektiren durumları hızla işaretlemek.

- Performans darboğazlarının önceden öngörülmesi: belirli bir mikroservisin yanıt süresi aniden yükseldiğinde, kaynağın başka işlemlerle yarıştığını gösteren bağlam bilgilerinin keşfi.

- Log temizliği ve düzeni: eski logları düzenlemek, gereksiz veriyi temizlemek ve güvenlik politikalarına uyum sağlamak için otomatik arşivleme süreçleri uygulanabilir.

Örnek senaryo: Bir bulut tabanlı hizmet sağlayıcısı, müşteri isteklerini işleyen ana hizmetlerinde ani hata artışları ile karşılaştı. Özellik mühendisliği ile geliştirilen ajanlar, 5 ve 15 dakikalık pencerelerde hatalı istek yoğunluğunu tespit etti ve bu bilgiler, güvenlik odaklı modellerle korele edilerek DDoS benzeri bir saldırı ihtimaline işaret etti. Sonuç olarak, güvenlik ekibi alarmı hızla tetikledi ve ağ güvenliği politikalarında geçici bir değişiklik yapıldı. Bu işlem, sunucu güvenliği, sunucu kurulumu ve işletim sistemleri bağlamında operasyonel riskleri önemli ölçüde azaltmıştır.

Sonuç ve Yol Haritası

Yapay zeka destekli özelleştirilmiş anomali tespiti, sunucu logları üzerinde anlamlı içgörüler elde etmek için güçlü bir araçtır. Ancak başarı için sistemli bir yaklaşım gerekir. Aşağıda, adım adım uygulanabilir bir yol haritası bulunmaktadır:

- Mevcut log altyapınızı envanterleyin: hangi loglar, hangi sürümlerde, hangi amaçla kullanılıyor?

- Veri temizliği ve normalizasyon kuralları oluşturun: tarih/saat normalize edin, gereksiz alanları temizleyin.

- Özellik mühendisliğini başlatın: zaman pencereleri, agregatlar ve bağlamsal özellikler geliştirin.

- Bir ölçeklenebilir mimari tasarlayın: Kafka-Flink/Spark ile gerçek zamanlı işleme, kubernetes tabanlı dağıtım.

- Model izleme ve sürüm yönetimini kurun: her modelin performansını izleyin, gerektiğinde yeniden eğitin.

- Geri bildirim mekanizması kurun: güvenlik müdahalelerinin sonuçlarını modele aktarın.

- Güvenlik ve uyum kontrolü için politikalar belirleyin: log saklama süreleri, yetkilendirme ve erişim denetimleri.

Sonuç olarak, sunucu kurulumu, sunucu güvenliği, sunucu temizliği, sunucu logları, sunucu tercihleri ve işletim sistemleri bağlamında yapay zeka destekli anomali tespiti, operasyonel verimliliği artırır, güvenlik olaylarının etkilerini azaltır ve bakım süreçlerini sadeleştirir. Bu yaklaşım, güncel teknolojik trendlerle uyumlu bir şekilde, ölçeklenebilir ve güvenilir bir altyapı kurmanıza katkı sağlar. Deneyimlerimize göre, en iyi sonuçlar, küçük adımlarla başlayıp sonuçları ölçerek genişletilen bir yol haritasında elde edilir.

Ek Sık Sorulan Sorular

Sunucu loglarında yapay zeka destekli özelleştirilmiş anomali tespiti nasıl çalışır?

Özetle; veri toplama ve temizleme ile başlar, ardından zaman serisi özellikleri üretilir, modeller bu özellikleri kullanarak normal davranış profili oluşturur ve sapmalar anomali skorları ile işaretlenir. Dağıtık altyapıda skorlar gerçek zamanlı olarak üretilir ve olay müdahale süreçleri otomatik tetiklenir.

Hangi özellikler en etkili olabilir?

Zaman serisi trendleri, hata oranı ve oturum açma başına yoğunluk, coğrafi dağılım ve IP tabanlı korelasyonlar genelde güçlü sinyaller sağlar. Bağlam bilgilerinin (kullanıcı ajanı, sürüm, modül) dahil edilmesi de tespit doğruluğunu artırır.

Ölçeklenebilirlik için hangi teknolojiler gerekir?

Kafka ve Flink/Spark gibi akış işleme teknolojileri ile Kubernetes bazlı dağıtım, ölçeklenebilirlik ve hata toleransı sağlar. ML modülleri için MLFlow veya Kubeflow gibi sürüm yönetimi çözümleri kullanılır.